Każdego dnia miliony ludzi na całym świecie rozmawiają z ChatGPT, Claude czy Gemini - nowoczesnymi asystentami opartymi na sztucznej inteligencji. Pomagają one pisać teksty, tłumaczyć języki, planować projekty, analizować dokumenty czy rozwiązywać złożone problemy. Jeszcze kilka lat temu takie narzędzia wydawały się science fiction - dziś stają się nieodłączną częścią pracy wielu przedsiębiorstw.

Ale jak właściwie działają te zaawansowane systemy? Jak to możliwe, że potrafią tworzyć odpowiedzi tak spójne i sensowne, że często brzmią, jakby pisał je człowiek?

W tym artykule przyjrzymy się, jak funkcjonują duże modele językowe (LLM - Large Language Models). Wyjaśnimy ich zasady działania, pokażemy, co stoi za ich niezwykłą skutecznością i jak zrozumienie ich mechanizmów może pomóc przedsiębiorcom wykorzystywać AI mądrzej i bezpieczniej.

Czym są modele LLM?

Duże modele językowe to programy komputerowe oparte na sztucznej inteligencji, stworzone po to, by rozumieć i generować ludzki język. Można myśleć o nich jak o super-zaawansowanych systemach przewidywania tekstu - podobnych do funkcji autouzupełniania w telefonach, ale o tysiące razy potężniejszych i bardziej złożonych.

W odróżnieniu od dawnych algorytmów opartych na sztywnych regułach, modele LLM uczą się same, analizując miliardy przykładów tekstów z książek, stron internetowych, forów dyskusyjnych czy kodu źródłowego. Dzięki temu są w stanie rozpoznać wzorce językowe, zrozumieć kontekst i dopasować odpowiedź do sytuacji, w jakiej pojawia się pytanie.

To właśnie dlatego ChatGPT potrafi streścić raport, pomóc w napisaniu maila handlowego albo zaproponować plan działań dla zespołu projektowego. Nie ma świadomości ani emocji, ale na podstawie danych potrafi precyzyjnie przewidywać, jakie słowa powinny pojawić się w danym kontekście.

Dla biznesu oznacza to coś przełomowego - możliwość pracy z maszyną, która rozumie język naturalny, a nie tylko zestaw poleceń.

Podstawowe zasady działania

Od słów do liczb: tokenizacja

Choć modele językowe operują na tekście, w rzeczywistości „myślą” w liczbach. Komputery nie rozumieją słów - przetwarzają dane matematyczne. Dlatego zanim model AI zacznie analizować zdanie, musi przekształcić je w formę liczbową.

Ten proces nazywamy tokenizacją.

Wyobraźmy sobie zdanie:

„Kot siedzi na macie.”

Model rozbija je na mniejsze elementy - tzw. tokeny. Token może być całym słowem („Kot”), jego fragmentem („sied”), końcówką („zi”) albo nawet znakiem interpunkcyjnym („.”). Każdy token otrzymuje unikalny numer identyfikacyjny.

Na przykład:

- „Kot” → 1234

- „siedzi” → 5678

- „na” → 9012

- „macie” → 3456

Inny przykład w formie diagramu:

Dzięki temu tekst można zamienić na sekwencję liczb, które da się przetwarzać matematycznie. Dla orientacji: tysiąc słów w języku naturalnym odpowiada około 1300-1500 tokenom.

Tokenizacja to pierwszy krok do tego, by komputer mógł „rozumieć” język. Dopiero po niej możliwe jest nadanie słowom znaczeń - a tym zajmuje się kolejny etap.

Embeddingi: kodowanie znaczeń

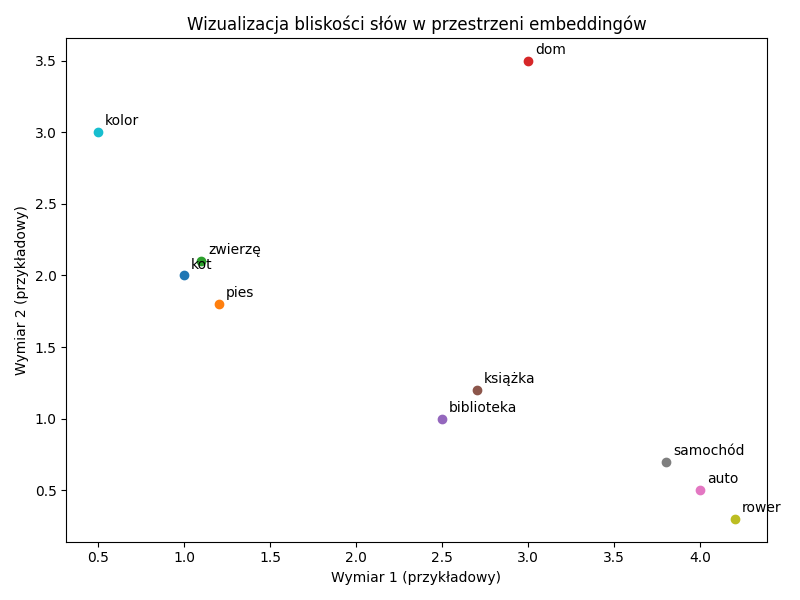

Gdy tekst zostanie rozbity na tokeny, model przekształca każdy z nich w coś, co nazywamy embeddingiem. To wielowymiarowy wektor - zestaw liczb, który opisuje znaczenie danego słowa oraz jego relacje z innymi.

Najprościej można to porównać do mapy znaczeń. Na tej mapie słowa o podobnym sensie znajdują się blisko siebie, a te zupełnie różne - daleko od siebie.

Dzięki embeddingom model „wie”, że słowa „pies” i „kot” są do siebie podobne, bo oba odnoszą się do zwierząt domowych. Z kolei „kot” i „hamburger” są odległe - nie mają semantycznego związku.

W praktyce oznacza to, że model nie tylko zna słowa, ale rozumie ich kontekst. Widzi różnicę między „rachunkiem w restauracji” a „rachunkiem bankowym”. To właśnie ta matematyczna struktura znaczeń pozwala mu zrozumieć, o czym rozmawia z użytkownikiem.

W embeddingach kryje się potęga dużych modeli językowych - to dzięki nim AI potrafi tworzyć sensowne zdania, odpowiadać logicznie i reagować na kontekst rozmowy.

Architektura transformerów - serce modelu LLM

Czym są transformery?

Współczesne modele językowe, takie jak ChatGPT, Claude czy Gemini, opierają się na architekturze zwanej transformerem. To właśnie ona całkowicie zmieniła sposób, w jaki sztuczna inteligencja „rozumie” język.

Transformery po raz pierwszy opisano w 2017 roku w pracy naukowej zatytułowanej „Attention is All You Need” - i rzeczywiście, ta koncepcja okazała się wszystkim, czego potrzeba, by AI zaczęła mówić jak człowiek.

Wcześniejsze modele analizowały zdania słowo po słowie, co było wolne i ograniczone. Transformer potrafi spojrzeć na cały tekst jednocześnie - na wszystkie słowa w zdaniu, a nawet w akapicie. Dzięki temu może zrozumieć kontekst i relacje między poszczególnymi fragmentami, a nie tylko ich kolejność.

Efekt? Zamiast odtwarzać język według reguł, model potrafi uchwycić znaczenie, intencję i sens całej wypowiedzi.

Mechanizm uwagi (attention)

Najważniejszym elementem transformera jest mechanizm uwagi - serce modelu, które decyduje, na czym skupić się w danym momencie.

Można to porównać do naszej ludzkiej koncentracji. Kiedy czytamy zdanie:

„Korona tego drzewa jest piękna.”

wiemy, że słowo „korona” nie oznacza korony, którą wkłada się na głowę, tylko górną część drzewa. Dzieje się tak dlatego, że nasz mózg zwraca uwagę na kontekst - słowa „drzewa”.

Transformer robi dokładnie to samo. Mechanizm uwagi analizuje każde słowo w kontekście wszystkich pozostałych i przypisuje im wagi - czyli określa, które z nich są dla siebie najistotniejsze.

Dzięki temu model potrafi zrozumieć znaczenie zdań złożonych, idiomów czy metafor. W praktyce działa to tak:

- Model analizuje wszystkie słowa w zdaniu.

- Określa, które są dla siebie najważniejsze.

- Tworzy nowe, bogatsze reprezentacje tych słów z uwzględnieniem kontekstu.

Im więcej tzw. „głów uwagi” ma model, tym precyzyjniej potrafi analizować złożone relacje językowe. GPT-2 miał ich 12, GPT-4 - setki.

Warstwy neuronowe

Transformery składają się z wielu warstw - można to porównać do warstw w procesie rozumienia przez człowieka.

- Pierwsze warstwy wychwytują podstawowe elementy, czyli pojedyncze słowa.

- Kolejne analizują relacje między nimi - np. kto co zrobił.

- Ostatnie warstwy budują zrozumienie sensu całego zdania lub akapitu.

To trochę jak analiza obrazu: najpierw dostrzegasz kolory i kształty, potem rozpoznajesz twarze, a na końcu emocje.

Oryginalny transformer miał po sześć warstw w części analizującej (enkoderze) i generującej (dekoderze). Dzisiejsze modele mają ich setki, co pozwala im przetwarzać ogromne ilości informacji i rozumieć złożone treści.

Proces trenowania modelu

Faza wstępnego treningu (pre-training)

Zanim model zacznie z kimkolwiek rozmawiać, musi się „nauczyć” języka - a to proces trwający tygodniami i kosztujący dziesiątki milionów dolarów.

Podczas tej fazy model analizuje niewyobrażalne ilości tekstu: książki, artykuły naukowe, posty z internetu, a nawet kod źródłowy. GPT-4 został wytrenowany na dziesiątkach bilionów tokenów.

Na tym etapie model nie uczy się faktów, ale wzorów języka. Jego zadanie jest proste: przewidzieć, jakie słowo pojawi się dalej.

Dostaje początek zdania, np.:

„Pogoda dzisiaj jest bardzo…”

i ma odgadnąć, które słowo jest najbardziej prawdopodobne: „ładna”, „ciepła”, „zimna” - każdemu przypisując prawdopodobieństwo.

Po miliardach takich prób model zaczyna rozumieć nie tylko składnię, ale też strukturę języka, zależności między pojęciami i logikę ludzkiej wypowiedzi.

To uczenie nienadzorowane - model sam odkrywa reguły na podstawie danych.

Parametry - mózg modelu

Podczas treningu model dostosowuje miliardy, a czasem biliony tzw. parametrów - wewnętrznych zmiennych, które decydują o tym, jak przetwarza informacje.

Można to porównać do synaps w ludzkim mózgu. Każdy parametr reguluje siłę połączenia między różnymi częściami sieci neuronowej.

Im więcej parametrów, tym bardziej złożony i precyzyjny jest model:

- GPT-2 - 1,5 miliarda parametrów,

- GPT-3 - 175 miliardów,

- GPT-4 - szacunkowo ponad bilion.

Dla porównania, ludzki mózg ma ok. 100 bilionów synaps. Dzisiejsze modele zaczynają zbliżać się do tej skali złożoności, choć ich sposób działania jest zupełnie inny.

Dostrajanie (fine-tuning)

Po wstępnym treningu model ma ogromną wiedzę, ale nie zawsze potrafi z niej korzystać w sposób bezpieczny i użyteczny. Dlatego przechodzi etap dostrajania.

W tej fazie jest uczony na mniejszych, starannie wybranych zestawach danych, jak powinien się zachowywać:

- odpowiadać rzeczowo i pomocnie,

- przyznawać się do niewiedzy,

- unikać niestosownych treści,

- nie wprowadzać użytkownika w błąd.

Często w tym procesie uczestniczą ludzie - oceniają odpowiedzi modelu i wskazują, które są lepsze. Dzięki temu system uczy się reagować w sposób bardziej „ludzki”.

Właśnie ten etap sprawia, że współczesne modele - jak ChatGPT - potrafią prowadzić rozmowy naturalne, kulturalne i często zaskakująco trafne.

Jak model generuje odpowiedzi?

Kiedy wpisujesz pytanie do chatbota AI, w ciągu ułamka sekundy dzieje się cały ciąg precyzyjnych operacji. Proces ten można opisać w kilku etapach.

Krok 1: Przetwarzanie zapytania

Twoje pytanie najpierw przechodzi przez tokenizację i embedding - czyli zostaje przekształcone z tekstu w zestaw liczb, które reprezentują znaczenia poszczególnych słów.

Model nie widzi więc zdań w formie liter, tylko zbiory wektorów, które opisują znaczenie i powiązania między słowami.

Krok 2: Analiza kontekstu

Następnie model analizuje Twoje pytanie w całości. Dzięki mechanizmowi uwagi potrafi określić, które słowa są najważniejsze, jakie mają między sobą zależności i jaki jest sens całego zdania.

Jeśli rozmawiasz z nim już dłużej, model bierze pod uwagę wcześniejsze wiadomości - o ile mieszczą się one w jego tzw. „oknie kontekstu” (czyli maksymalnej liczbie tokenów, które potrafi analizować jednocześnie).

To dlatego ChatGPT potrafi kontynuować rozmowę, pamiętając, o czym była mowa kilka minut wcześniej.

Krok 3: Przewidywanie kolejnego tokena

Gdy kontekst jest już zrozumiały, model przechodzi do generowania odpowiedzi. Nie tworzy jej jednak od razu w całości - działa krok po kroku, przewidując kolejne tokeny, czyli najmniejsze fragmenty tekstu.

Można to porównać do pisania zdania litera po literze, tyle że w skali matematycznej.

Dla przykładu, jeśli model zaczyna odpowiedź od słów:

„Stolicą Polski jest...”

to następnie oblicza prawdopodobieństwa dla wszystkich możliwych słów, które mogłyby pojawić się dalej. Wynik może wyglądać tak:

- „Warszawa” - 95%,

- „stolica” - 2%,

- „miasto” - 1%,

- inne słowa - 2%.

Najczęściej wybiera najbardziej prawdopodobną opcję, choć czasem wprowadza element losowości, by odpowiedzi nie były zbyt schematyczne.

Krok 4: Iteracja

Wybrany token staje się częścią odpowiedzi i służy do przewidzenia następnego. Proces powtarza się tysiące razy, aż model uzna, że odpowiedź jest kompletna lub napotka specjalny „token końca”.

To właśnie dlatego użytkownicy widzą, jak zdania pojawiają się na ekranie stopniowo - model naprawdę „pisze” je w czasie rzeczywistym, przewidując kolejne fragmenty.

Ten proces jest niezwykle wydajny - dla użytkownika trwa ułamek sekundy, ale w tle angażuje setki tysięcy parametrów i obliczeń.

Ograniczenia i wyzwania

Choć modele językowe robią ogromne wrażenie, nie są wolne od ograniczeń. Ich działanie opiera się na statystyce, a nie na prawdziwym rozumieniu świata - to oznacza, że mogą popełniać błędy, a nawet wprowadzać w błąd użytkownika.

Halucynacje

Jednym z największych problemów LLM są tzw. halucynacje - czyli sytuacje, gdy model generuje informacje brzmiące wiarygodnie, ale całkowicie nieprawdziwe.

Dzieje się tak, bo model nie sprawdza faktów - po prostu przewiduje, które słowa statystycznie pasują do kontekstu. Jeśli w jego zbiorach treningowych pojawiły się błędne informacje, może je powielać.

Znanym przykładem jest sprawa amerykańskiego prawnika Stephena Schwartza, który w 2023 roku użył ChatGPT do przygotowania pism sądowych. Model „wymyślił” istniejące sprawy, które nigdy nie miały miejsca.

Wniosek jest prost: AI może pomagać, ale zawsze wymaga czujnego użytkownika.

Zależność od danych treningowych

Model może być tylko tak dobry, jak dane, na których go nauczono.

Jeśli w danych znajdują się błędy, uprzedzenia czy brak różnorodności perspektyw, model będzie je powielał.

Dlatego tak ważne jest, by firmy świadomie dobierały modele i dbały o jakość danych, które trafiają do treningu lub dalszego uczenia.

Ograniczenia kontekstu

Każdy model ma tzw. okno kontekstu, czyli maksymalną liczbę tokenów, jaką może analizować jednocześnie.

W praktyce oznacza to, że jeśli rozmowa lub dokument są zbyt długie, AI „zapomni” wcześniejsze fragmenty.

Choć nowoczesne modele jak Gemini 1.5 mogą obsłużyć do miliona tokenów, większość komercyjnych wersji ma dużo mniejsze limity.

To powód, dla którego czasem warto dzielić długie dokumenty na mniejsze fragmenty lub stosować narzędzia pomagające modelowi zachować pamięć.

Brak prawdziwego rozumienia

Mimo imponujących zdolności, LLM nie rozumieją treści tak jak ludzie.

Nie mają świadomości, celów ani intencji - działają w oparciu o wzorce językowe.

Nie „wiedzą”, co oznacza zdanie - tylko przewidują, jakie słowa powinny nastąpić po sobie.

To oznacza, że ich inteligencja jest funkcjonalna, a nie poznawcza. Doskonała w praktyce, ale pozbawiona świadomości.

Koszty obliczeniowe i ekologiczne

Trening modeli takich jak GPT-4 czy Gemini kosztuje dziesiątki milionów dolarów i wymaga ogromnej mocy obliczeniowej.

Każde zapytanie do modelu to realne zużycie energii - a im więcej użytkowników, tym większe obciążenie dla środowiska.

Z tego powodu firmy AI pracują nad bardziej efektywnymi algorytmami i energooszczędnymi infrastrukturami.

Przyszłość modeli LLM

Rozwój sztucznej inteligencji przyspiesza w tempie, jakiego wcześniej nie widzieliśmy. To, co dziś robią ChatGPT, Claude czy Gemini, jeszcze kilka lat temu wydawało się niemożliwe. A jednak jesteśmy dopiero na początku tej drogi.

Eksperci przewidują, że kolejne lata przyniosą kilka kluczowych kierunków zmian.

Większa efektywność

Obecne modele są ogromne i kosztowne w utrzymaniu, ale trwają intensywne prace nad mniejszymi, tańszymi i szybszymi wersjami.

Tzw. Small Language Models (SLM) będą w stanie działać lokalnie - na komputerach firmowych lub w prywatnych chmurach - bez potrzeby wysyłania danych do zewnętrznych serwerów.

Dla przedsiębiorstw oznacza to większe bezpieczeństwo i możliwość tworzenia własnych modeli wyspecjalizowanychw konkretnych branżach, np. prawniczej, medycznej czy finansowej.

Integracja z rzeczywistością

Kolejnym krokiem będzie łączenie modeli językowych z aktualnymi źródłami danych.

Nowe wersje będą mogły przeszukiwać internet, sprawdzać fakty w czasie rzeczywistym i cytować źródła, na których się opierają.

To rozwiąże jeden z największych problemów obecnych LLM - brak bieżącej wiedzy po dacie ich treningu.

Multimodalność

Modele językowe coraz częściej łączą różne rodzaje danych: tekst, obraz, dźwięk i wideo.

Już dziś GPT-4 potrafi analizować zdjęcia, a Gemini rozumie zarówno tekst, jak i obraz jednocześnie.

To oznacza, że w niedalekiej przyszłości jeden system będzie w stanie:

- przeczytać raport,

- obejrzeć wykres,

- wysłuchać nagrania,

- i przygotować z tego spójne podsumowanie.

Dla biznesu to otwarcie drzwi do zupełnie nowego sposobu pracy z informacją.

Specjalizacja

Zamiast jednego „wszechwiedzącego” modelu, coraz częściej będziemy korzystać z całego ekosystemu wyspecjalizowanych LLM, dostosowanych do konkretnych zadań.

Będą modele medyczne, prawnicze, edukacyjne czy analityczne - każdy zoptymalizowany do swojego obszaru.

To zjawisko już dziś widać w firmach, które trenują własne modele na wewnętrznych dokumentach, tworząc tzw. RAG(Retrieval-Augmented Generation) - systemy potrafiące odpowiadać na pytania na podstawie firmowej wiedzy.

Etyka i bezpieczeństwo

W miarę jak AI staje się częścią codziennego życia, rośnie znaczenie tematów takich jak etyka, transparentność i prywatność.

Firmy rozwijające modele - od OpenAI po Google i Anthropic - coraz większy nacisk kładą na ograniczanie uprzedzeń, ochronę danych i zapobieganie nadużyciom.

Powstają też inicjatywy regulacyjne - zarówno w Unii Europejskiej, jak i w Stanach Zjednoczonych - które mają zapewnić, że rozwój AI będzie odpowiedzialny i zgodny z interesem społecznym.

W telegraficznym skrócie

Modele LLM, takie jak ChatGPT, Claude czy Gemini, to dziś jedno z najpotężniejszych narzędzi technologicznych naszych czasów. Oparte na architekturze transformerów, „uczą się” języka poprzez analizę miliardów przykładów tekstu.

Ich działanie można podsumować w kilku prostych krokach:

- Tokenizacja - dzielenie tekstu na mniejsze jednostki,

- Embeddingi - zamiana słów w liczby opisujące znaczenia,

- Mechanizm uwagi - analiza kontekstu,

- Warstwy neuronowe - pogłębianie rozumienia,

- Przewidywanie tokenów - generowanie tekstu krok po kroku.

W efekcie powstaje system, który nie myśli jak człowiek, ale potrafi zaskakująco skutecznie naśladować sposób, w jaki komunikujemy się i przekazujemy wiedzę.

Dlaczego warto to rozumieć?

Dla przedsiębiorców i menedżerów zrozumienie, jak działają modele LLM, to dziś strategiczna kompetencja.

Pozwala mądrzej dobierać narzędzia, oceniać ich wiarygodność i wykorzystywać je w sposób, który realnie wspiera biznes - zamiast zastępować człowieka tam, gdzie jego rola jest niezastąpiona.

Sztuczna inteligencja nie jest ani magią, ani zagrożeniem. To po prostu kolejne narzędzie - potężne, ale wymagające wiedzy i świadomości.

Zrozumienie jego zasad działania daje przewagę każdemu, kto chce nie tylko nadążać za zmianami, ale je wykorzystywać.

Spojrzenie w przyszłość

W kolejnych latach AI stanie się tak samo oczywista jak dziś internet czy smartfon.

Różnicę między liderami a spóźnionymi firmami zrobi nie sama technologia, lecz sposób, w jaki zostanie wdrożona i zrozumiana.

Dlatego warto już teraz uczyć się, eksperymentować i obserwować rozwój dużych modeli językowych - bo to właśnie one będą jednym z kluczowych motorów cyfrowej transformacji.